CMMLU 是一个专为评估中文大模型而设计的综合性基准平台。近年来,随着人工智能技术的迅猛发展,特别是在自然语言处理领域,大模型的出现极大地提升了机器对语言的理解和处理能力。然而,如何客观、公正地评估这些大模型的性能,尤其是在中文环境中的表现,一直是一个具有挑战性的问题。CMMLU 的出现为这一难题提供了一个系统化的解决方案。

CMMLU 的核心功能在于其全面的评估能力。它通过一系列精心设计的测试集,从多个维度对模型进行考核,包括但不限于语义理解、语言生成、文本分类、情感分析等。这些测试集不仅涵盖了日常对话、专业领域讨论等多种场景,还特别考虑到中文语言的复杂性,设计了多样化的题目以确保评估的全面性和准确性。

在数据来源方面,CMMLU 充分利用了来自网络、书籍、报刊等多渠道的优质中文语料库。这些语料库经过严格筛选和清洗,确保了数据的高质量和高可靠性。此外,CMMLU 还支持自定义数据集,用户可以根据自身需求,导入特定领域的数据进行模型测试。这种灵活性使得不同领域的研究人员和开发者都能从中受益。

易用性是 CMMLU 的另一大优势。该平台提供了清晰的使用文档和操作指南,即使是初学者也能快速上手。用户界面设计简洁直观,所有功能一目了然。此外,CMMLU 还支持与现有开发环境的无缝集成,开发者可以将其轻松嵌入到自己的项目中,进行连续的模型评估和优化。

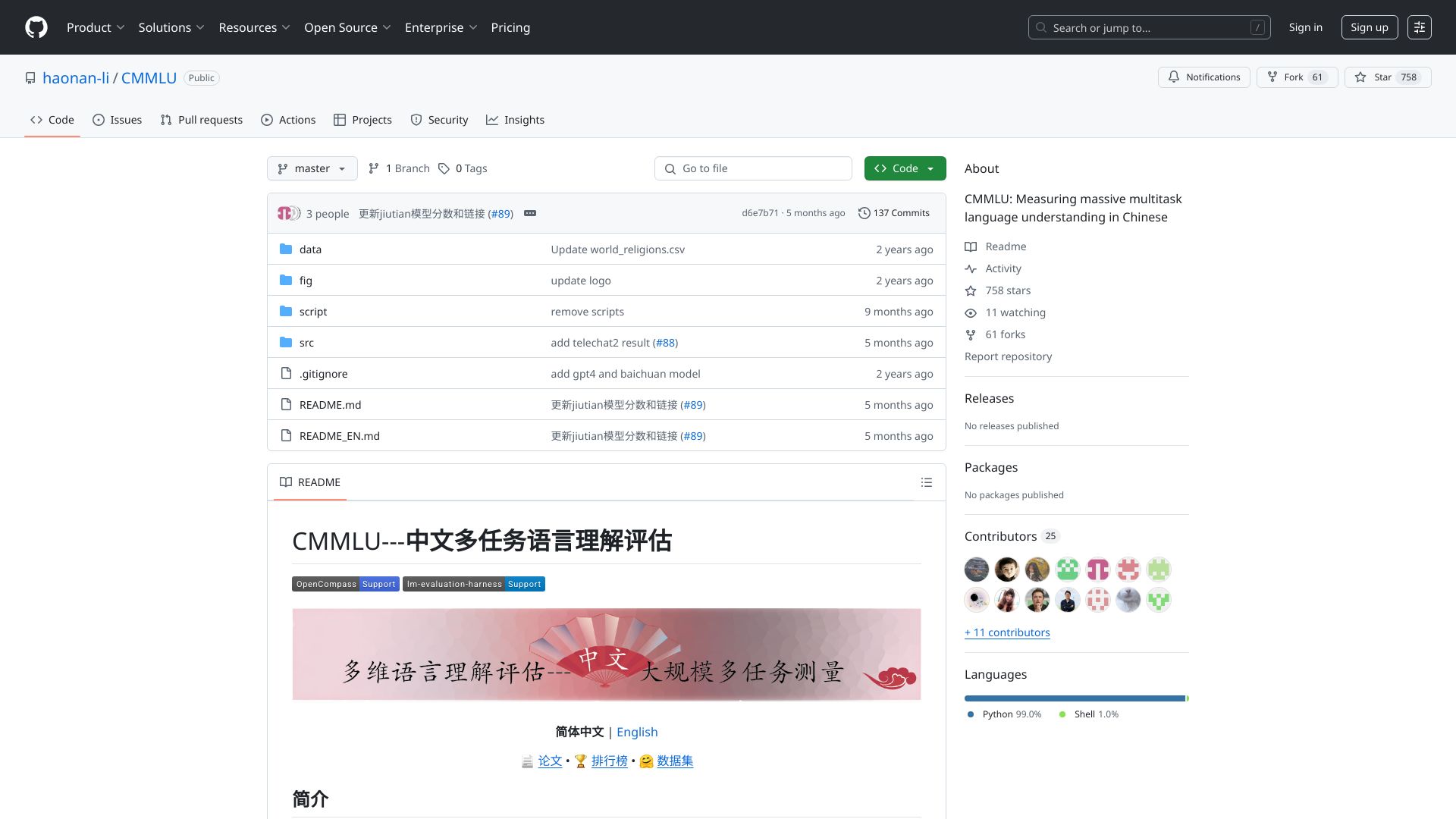

开放性和社区支持是 CMMLU 值得称道的地方。作为一个开源项目,CMMLU 鼓励开发者积极参与到平台的建设和改进中。通过 GitHub 社区,用户可以反馈使用过程中遇到的问题,提交新的功能建议,甚至直接参与代码的贡献。活跃的社区氛围使得 CMMLU 得以持续更新和完善,更好地适应技术发展的需求。

在未来,CMMLU 有着广阔的应用前景。随着中文大模型的不断发展和应用场景的不断扩展,CMMLU 将在教育、医疗、金融、法律等多个行业中发挥重要作用。通过对模型性能的客观评估,帮助开发者更好地了解和改进模型,从而推动人工智能技术在中文环境中的深入应用。

总的来说,CMMLU 是一个功能强大、灵活易用的中文大模型评估工具。它不仅为研究人员和开发者提供了一个标准化的评估平台,还通过社区的开放合作推动了人工智能技术的进步。如果你正在寻找一个能够全面评估中文大模型性能的工具,CMMLU 无疑是一个值得尝试的选择。